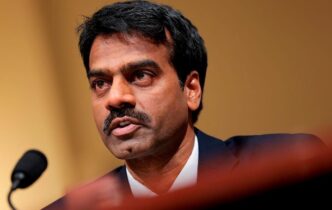

Головне: Виконувач обов’язків директора CISA Мадху Готтумуккала у серпні 2025 року завантажив до публічної версії ChatGPT службові документи з чутливими даними про контракти, що призвело до внутрішнього розслідування та посилення обмежень на ШІ-сервіси в агентстві.

На порталі UkrNews активно висвітлюють гучні кіберінциденти, і черговий з них стосується безпосередньо керівництва американського агентства з кібербезпеки. Виконувач обов’язків директора CISA (Cybersecurity and Infrastructure Security Agency) Мадху Готтумуккала минулого літа використав публічну версію ChatGPT для роботи з внутрішніми матеріалами агентства. Документи мали позначку «тільки для службового використання» і містили деталі укладених контрактів, хоча й не належали до класу секретних.

Цей крок став можливим завдяки тимчасовому спеціальному дозволу, який Готтумуккала отримав після призначення на посаду. Водночас у більшості федеральних відомств США доступ до публічних генеративних ШІ-сервісів, таких як ChatGPT від OpenAI, жорстко обмежений або повністю заблокований через високі ризики витоку інформації. Модель ChatGPT на той момент мала понад 700 мільйонів активних користувачів, що робило потенційне поширення даних критичним.

Інцидент виявили внутрішні системи моніторингу самого CISA. Після виявлення активували відповідні протоколи безпеки, розпочали службове розслідування. В офіційній заяві агентства зазначили:

«Використовували ChatGPT обмежено та в межі тимчасового дозволу».

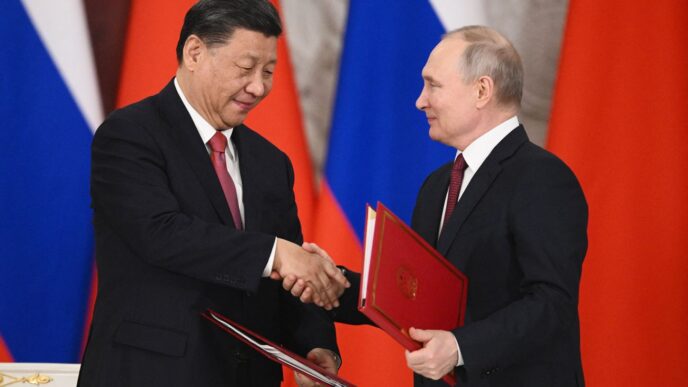

Після події використання публічних ШІ-сервісів у CISA залишилося заблокованим. Агентство відповідає за захист федеральних інформаційних мереж від кібератак, зокрема від загроз, які походять від державних хакерських груп Росії та Китаю, тому будь-який потенційний витік сприймається особливо гостро.

Експерти звертають увагу, що подібні випадки підкреслюють системну проблему: навіть у профільних структурах, які розробляють політики кібербезпеки, дотримання власних правил інколи викликає питання. Ситуація ілюструє ризики застосування генеративного ШІ у державному секторі без належних контрольних механізмів.

- Основні ризики використання публічних ШІ у держустановах:

- Автоматичне збереження введених даних для подальшого тренування моделей.

- Можливість непрямого доступу третіх осіб до чутливої інформації.

- Порушення внутрішніх політик конфіденційності та класифікації даних.

Подія вже привернула увагу профільних видань, зокрема Politico, яке першим оприлюднило деталі. Розслідування триває, а CISA продовжує посилювати внутрішні правила роботи з штучним інтелектом.